Sudah jadi pemandangan sehari-hari para pengguna media sosial Facebook membagikan berita dan berbagai konten daring di laman milik mereka. Namun, banyak informasi yang dibagikan itu tidak sesuai fakta atau hoaks, cenderung fitnah, mengandung pornografi, dan kekerasan. Lantas, bagaimana Facebook menghadapinya?

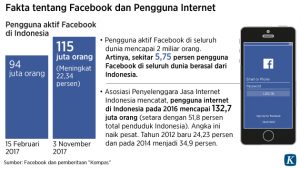

Product Manager News Feed Facebook Tessa Lyons-Laing menjelaskan, merebaknya hoaks adalah fenomena global yang tak hanya terjadi di Indonesia, tetapi juga di seluruh dunia. Ia mengakui, media sosial termasuk Facebook sering kali digunakan para pengguna internet sebagai media menyebarkan informasi hoaks itu. Informasi itu pun tersebar ke sesama pengguna Facebook karena ditampilkan di news feed timeline akun pengguna Facebook.

”Misi utama Facebook adalah memberikan setiap orang kemampuan untuk berbagi serta menjadikan dunia lebih terbuka dan terhubung. Namun, konten yang dibagikan miliaran pengguna kami ini beragam. Kami harus memastikan keamanan sesama pengguna Facebook lainnya,” ujar Tessa ditemui di kantor perwakilan Facebook di Indonesia, di Gedung Capital Place, Lantai 49, Jakarta, Jumat (3/11).

”Misi utama Facebook adalah memberikan setiap orang kemampuan untuk berbagi serta menjadikan dunia lebih terbuka dan terhubung. Namun, konten yang dibagikan miliaran pengguna kami ini beragam. Kami harus memastikan keamanan sesama pengguna Facebook lainnya,” ujar Tessa ditemui di kantor perwakilan Facebook di Indonesia, di Gedung Capital Place, Lantai 49, Jakarta, Jumat (3/11).

ADVERTISEMENT

SCROLL TO RESUME CONTENT

Tessa menjelaskan, untuk menghadapi hoaks, Facebook punya beberapa cara. Facebook memiliki otoritas untuk menghapus konten dan orang yang mengeposkan konten yang melanggar kebijakan standar komunitas Facebook.

Pengguna bisa melaporkan konten (bisa berupa gambar, video, ataupun tulisan) negatif yang dibagikan pengguna lainnya kepada pengelola Facebook melalui fitur report/laporan. Berdasarkan laporan itu, pengelola di kantor pusat Facebook akan mengkaji kesesuaian fakta dan konteks yang berlaku di masyarakat negara itu.

Pengguna bisa melaporkan konten (bisa berupa gambar, video, ataupun tulisan) negatif yang dibagikan pengguna lainnya kepada pengelola Facebook melalui fitur report/laporan. Berdasarkan laporan itu, pengelola di kantor pusat Facebook akan mengkaji kesesuaian fakta dan konteks yang berlaku di masyarakat negara itu.

Mengenai pengecekan fakta, di Amerika Serikat, Facebook bekerja sama dengan organisasi PolitiFacts untuk mencari kebenaran konten yang disebar pengguna akun Facebook tersebut. Sementara itu, di Indonesia, Facebook akan meminta pegawainya yang berkebangsaan Indonesia untuk mengkaji dan menilai konteks dari konten yang dinilai negatif itu.

Apabila ditemukan pelanggaran standar komunitas, seperti konten ketelanjangan dan ungkapan kebencian, Facebook memiliki otoritas untuk menghapus konten tersebut.

”Standar komunitas ini ditetapkan dengan mengusung empat tujuan, yakni untuk membantu menjaga Anda tetap aman, mendorong perilaku terhormat, amankan akun dan informasi pribadi pengguna, dan melindung hak kekayaan intelektual anda,” ujar Tessa.

Selain itu, Facebook telah menggelar beberapa inisiatif literasi digital, antara lain Think Before You Share. Kegiatan yang sudah dilakukan pada tahun kedua di Indonesia ini adalah sebuah inisiatif yang berfokus pada tips keamanan internet dan keahlian digital.

Unsur pimpinan pusat Facebook pun sudah pernah menyambangi Menteri Komunikasi dan Informatika Rudiantara pada Selasa (14/2) untuk membahas banyak hal, salah satunya adalah pengembangan konten positif. Saat itu, Kepala Kebijakan Produk Facebook Monika Bickert yang berangkat dari kantor pusat Facebook di Amerika mengatakan, pihaknya berkomitmen mengembangkan lingkungan positif di media sosial.

Unsur pimpinan pusat Facebook pun sudah pernah menyambangi Menteri Komunikasi dan Informatika Rudiantara pada Selasa (14/2) untuk membahas banyak hal, salah satunya adalah pengembangan konten positif. Saat itu, Kepala Kebijakan Produk Facebook Monika Bickert yang berangkat dari kantor pusat Facebook di Amerika mengatakan, pihaknya berkomitmen mengembangkan lingkungan positif di media sosial.

”Misalnya, ada akun yang menyatakan mendukung organisasi terorisme, pasti akan langsung kami blok permanen. Facebook juga mengusahakan agar orang tersebut tidak bisa membuka akun baru meskipun dengan nama lain,” ujar Monika ditemui seusai berjumpa dengan Rudiantara (Kompas, 15 Februari 2017).

Belum konsisten

Dihubungi terpisah, Direktur Indonesia New Media Watch Agus Sudibyo mengapresiasi inisiatif Facebook untuk menghapus konten negatif yang dinilai melanggar standar komunitas mereka. Namun, menurut dia, Facebook belum konsisten untuk melakukannya.

”Menyeruaknya kasus Saracen dan perkara Buni Yani menandakan Facebook belum benar-benar konsisten dan serius untuk menghapus konten negatif. Kalau memang dinilai melanggar standar komunitas dan ada laporan keberatan pengguna, mengapa posting seperti itu tidak segera dihapus,” ujar Agus, Jumat (3/11).

Ia juga menilai, Facebook belum konsisten dalam bersikap. Di Amerika Serikat, Facebook mengungkapkan permintaan maaf karena media sosialnya itu digunakan untuk memecah belah masyarakat disana dalam penyelenggaraan Pilpres Amerika Serikat.

Menyeruaknya kasus Saracen dan perkara Buni Yani menandakan Facebook belum benar-benar konsisten dan serius untuk menghapus konten negatif.

”Hal senada juga terjadi pada Pilkada DKI. Namun, mengapa mereka belum meminta maaf ke publik kita,” ujar Agus.

Di sisi lain, menurut Agus, payung hukum Indonesia belum membuat pengelola media sosial bertanggung jawab atas beredarnya konten negatif dan hoaks. Kanada, misalnya, apabila terjadi kasus hukum karena hoaks, Facebook sebagai pengelola media sosial akan dimintai pertanggungjawaban secara hukum. Sementara di Indonesia, karena belum diatur secara hukum, Facebook belum pernah dihadirkan dalam sidang terkait perkara hoaks.

Selain itu, Indonesia juga harus meniru Jerman yang membuat aturan tegas kepada pengelola media sosial. Di Jerman, apabila ditemukan konten hoaks, Facebook harus segera menghapusnya dalam waktu setidaknya 1 x 24 jam. Apabila tidak, pemerintah akan mengenakan denda kepada Facebook.

Di Jerman, apabila ditemukan konten hoaks, Facebook harus segera menghapusnya dalam waktu setidaknya 1 x 24 jam. Apabila tidak, pemerintah akan mengenakan denda kepada Facebook.

”Poinnya di sini adalah tak hanya penyebar konten hoaks, pengelola media sosial juga harus diajak bertanggung jawab atas tersebarnya konten itu,” ujar Agus.–BENEDIKTUS KRISNA YOGATAMA

Sumber: Kompas, 3 November 2017